由ChatGPT引发的算力军备竞赛已经悄然而至了。

从另一个侧面也可以得到印证:近期,浪潮在接受媒体采访时,就曾对外表示,“AIGC火热带来AI服务器需求量的爆增,3月份我们发现AI(服务器)市场出现几倍以上增长,以前(客户关注点)是能不能便宜点,现在是能不能用得上。”

近日,有媒体援引知情人士消息称,特斯拉CEO马斯克在推特内部启动了一项人工智能项目,为此购买了约1万个GPU。

在此之前,在业界就不断流传各个互联网大厂都在紧急备货GPU,为其大模型开路。

地主家也没余粮。ChatGPT 本身也一直被算力紧缺所困扰。4 月 6 日, ChatGPT 就" 因需求量太大暂停了升级服务 ",并停止 Plus 付费项目的销售。

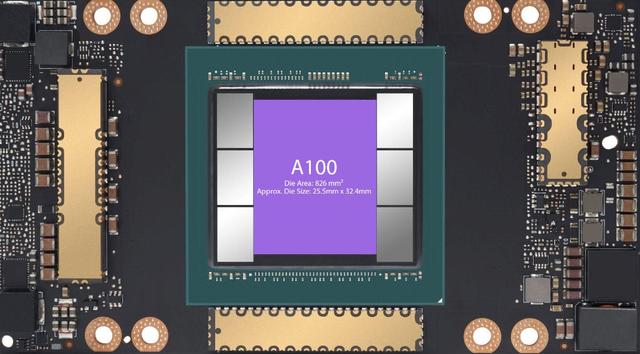

为了给ChatGPT 提供算力保障,其金主爸爸微软可以说劳心劳力。据悉,微软用几亿美元,耗费上万张英伟达A100芯片打造超算平台,只为给ChatGPT和新版必应提供更好的算力。不仅如此,微软还在Azure的60多个数据中心部署了几十万张GPU,用于ChatGPT的推理。

事实上,算力紧张这件事情,是从一开始就伴随着ChatGPT 。当初OpenAI选择与微软合作,算力就是一个至关重要的考虑因素。据悉,OpenAI在最初商量与微软合作时,OpenAI要求微软在Azure云计算平台上“腾出”足够的算力单独给它们使用,且确保它们不与Azure提供的其他服务产生冲突。

业界普遍认为,大模型是巨头们的“玩具”,动辄上亿元的投入,小玩家是上不了“赌桌”的。

但是,不要忘了ChatGPT这类大模型有两面,一方面是模型训练,另一方面是模型推理应用。动辄几亿的算力投入,还只是模型训练阶段。在模型推理应用阶段,对于算力的需求,要远远高于训练阶段。

接下来,我们致力于搞清楚为什么ChatGPT这类大模型这么“吃”算力。尤其是要搞清楚在大模型的应用阶段,用户量、业务量跟底层算力需求是什么关系。在此基础上,我们来测算,要支撑足够的用户量和业务规模,到底需要多少算力(尤其是GPU)。

先来看看训练阶段的算力消耗。

训练大型模型需要大量的算力,因为需要处理海量的数据。训练这类模型所需的算力取决于以下因素:模型的规模(参数数量)、训练数据集的大小、训练轮次、批次大小。

在此,我们假定要训练一个千亿规模的大模型,用1PB数据进行训练,训练一次,并且在10天内完成训练。看看需要消耗多少算力,并计算这样的算力消耗,如果用英伟达的芯片,需要多少芯片。

首先,我们要了解一个概念,即FLOPs(浮点运算次数)。FLOPs用来衡量执行某个任务所需的计算量。假设一个千亿(1000亿)参数的大型模型,我们可以参考GPT-3。GPT-3中最大的模型(1750亿参数)的训练大约需要3.14 * 10^23次浮点运算(FLOPs)。

我们可以通过以下简化公式估算所需的FLOPs:

所需FLOPs = (千亿参数 / 1750亿参数) * 3.14 * 10^23 FLOPs

根据这个公式,我们得出训练一个千亿参数的模型大约需要1.8 * 10^23次浮点运算。

接下来,我们来看看英伟达的芯片。以英伟达A100 GPU为例,其具有每秒19.5万亿次(19.5 TFLOPs)的浮点运算能力。

要计算出需要多少个A100 GPU来满足这个算力需求,我们可以使用以下公式:

所需GPU数量 = 1.8 * 10^23 FLOPs / (19.5 * 10^12 FLOPs/s * 训练时间秒数)

如果希望在10天(约864000秒)内完成训练,可以按照以下计算方式得到所需GPU数量:

所需GPU数量 = 1.8 * 10^23 FLOPs / (19.5 * 10^12 FLOPs/s * 864000s)

根据这个公式,在10天内训练1000亿参数规模、1PB训练数据集,大约需要10830个英伟达A100 GPU。

接下来,我们来计算大模型的训练成本。

要计算训练一个千亿规模大型模型的总费用,我们需要考虑以下因素:GPU成本、其他硬件成本(如CPU、内存、存储等)、数据中心成本(如电力、冷却、维护等)、人力成本。

还是上面的例子,需要在10天内训练1000亿参数规模的大模型,总的成本如下:

2025-02-22 洪笛童

AI和人一样,都有自己的擅长领域,你感觉DeepSeek、文心一言、ChatGPT、Kimi、豆包、通义千问哪个AI工具更好用呢?这也意味着,文心一言与DeepSeek之间的战争,正式拉开序幕。

2023-05-30 洪笛童

ChatGPT火爆的数月间,兴奋与焦虑构成了众生相,明面上,一众科技公司和成名大咖挤进大模型赛道;暗地里,一些普通人在风口下寻觅着赚钱新机。李明飞就是这些普通人中的一员,他从2月份开始售卖ChatGPT账号,“批号”成本两块三,最初能卖出99块的高价。等到ChatGPT的App在美国上市时,账号市场价降到了30元,利润...

2023-05-09 洪笛童

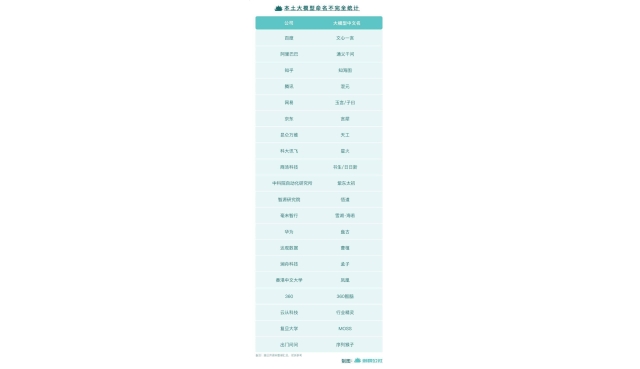

随着ChatGPT的威名席卷全球,大洋对岸的中国厂商也纷纷亮剑,各式本土大模型你方唱罢我登场,声势浩大的发布会排满日程表。有趣的是,在这些大模型产品初入历史舞台之时,带给世人的第一印象其实不是以亿为单位的参数规模,也不是那些遍布英文缩写的模型特征。事实上,人们第一眼见到的只是名字。具体来说,是一个又一个奇特甚至稍显玄奥...

2023-05-01 洪笛童

ChatGPT是一种非常强大的人工智能技术,它可以为我们提供各种变现机会。在这篇文章中,我们将介绍11种使用ChatGPT赚钱的方法。1. 利用ChatGPT生成视频脚本,制作高质量的视频,并在视频平台上获得广告收益。2. 使用ChatGPT为SEO生成内容和关键词,以提高网站的流量和广告收益。3. 使用ChatGPT...

2023-04-29 洪笛童

最近被 ChatGPT 刷屏了。网上也是铺天盖地各种相关文章。有从商业角度出发,剖析ChatGPT 会引发了怎样的商业浪潮;有从技术角度出发,分析ChatGPT 的底层原理和技术;又或者,直接向你推销各种各样的类似产品……如果你看了很多文章,依然没有搞明白,ChatGPT 到底是什么,跟你我有什么关系?那今天,我就斗胆...